- ChatGPT ganha nova função para detectar sofrimento emocional.

- Atualização evita respostas diretas em temas sensíveis.

- OpenAI ativa alertas para pausas em conversas longas.

A OpenAI está implementando melhorias importantes no ChatGPT com o objetivo de torná-lo mais sensível a sinais de sofrimento mental ou emocional. A empresa trabalha com especialistas e grupos consultivos para permitir que o chatbot forneça recursos baseados em evidências, caso identifique sinais de crise durante o uso.

Nos últimos meses, diversos relatos apontaram efeitos negativos causados pelo uso excessivo do chatbot em pessoas vulneráveis. Em alguns casos, o ChatGPT teria reforçado delírios ou dependência emocional, em vez de oferecer suporte. A empresa reconheceu as falhas:

Também sabemos que a IA pode ser mais responsiva e pessoal do que tecnologias anteriores, especialmente para indivíduos vulneráveis que passam por sofrimento mental ou emocional.

ChatGPT usará notificações e evitará conselhos em temas delicados

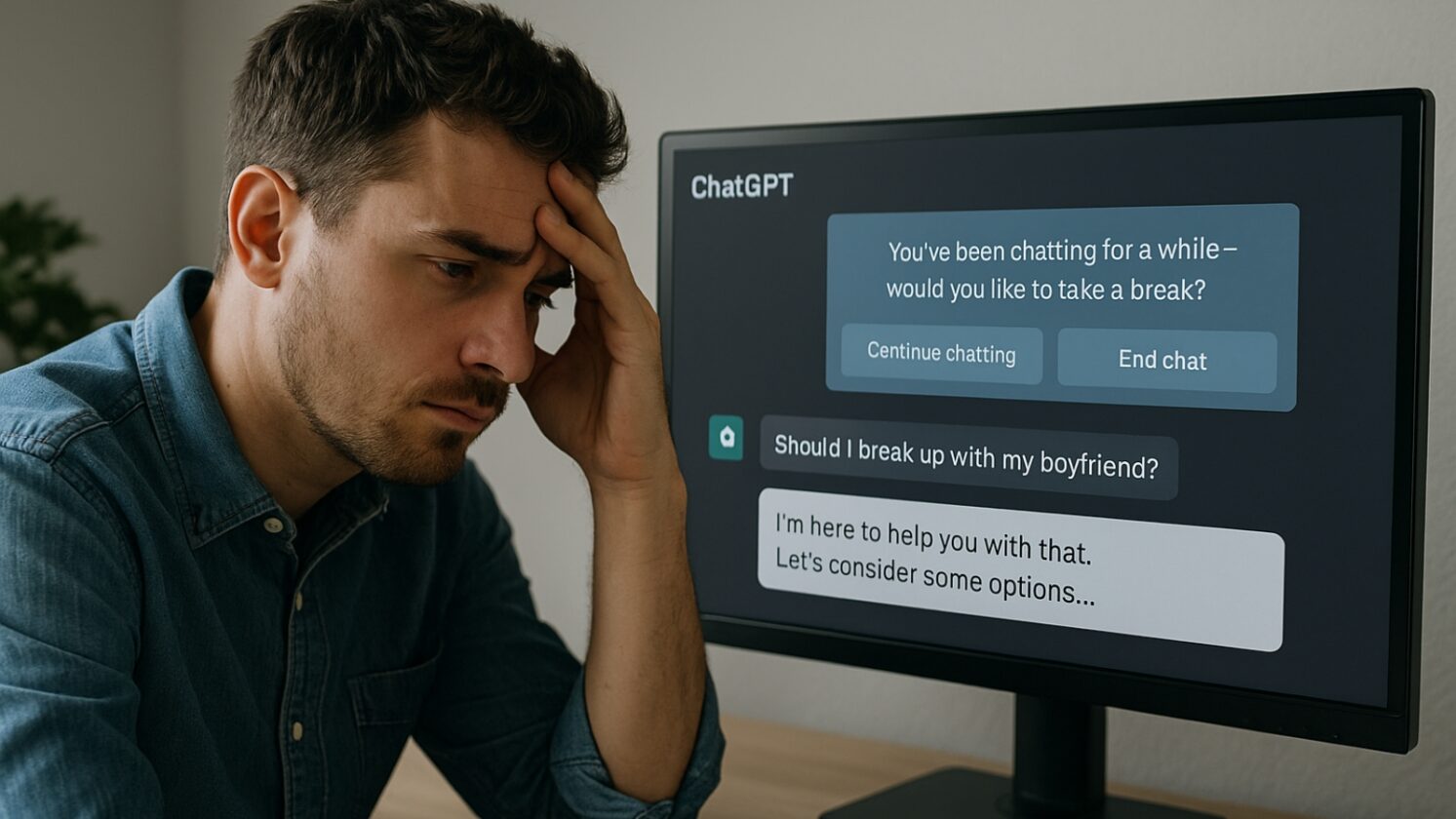

Como parte dessa atualização, a OpenAI lançará lembretes para pausas em sessões longas de conversa. Ao detectar uso prolongado, o ChatGPT exibirá uma notificação: “Você está conversando há algum tempo — este é um bom momento para uma pausa?”. Dessa forma, o usuário poderá optar por continuar ou encerrar a conversa.

Além disso, o modelo se tornará menos enfático ao responder perguntas de alto risco. Assim, em vez de dar respostas diretas para dúvidas como “Devo terminar com meu namorado?”, o ChatGPT ajudará a refletir sobre possíveis caminhos, respeitando o estado emocional do usuário.

Essas mudanças surgem após a OpenAI reverter uma atualização lançada em abril que tornou o chatbot “muito bajulador”. Na ocasião, a empresa reconheceu que respostas exageradamente positivas podem parecer perturbadoras ou desconfortáveis. De acordo com a nota oficial, o modelo GPT-4o “falhou em reconhecer sinais de delírio ou dependência emocional” em certos casos.

A empresa afirma que continuará ajustando “quando e como” os lembretes de pausa aparecerão. Plataformas como YouTube, TikTok, Instagram e Xbox, por exemplo, já adotaram mecanismos semelhantes. A Character.AI, do Google, também implementou recursos de segurança que alertam pais sobre as conversas dos filhos com bots de IA.

Com quase 700 milhões de usuários semanais, o ChatGPT agora tenta equilibrar avanço tecnológico com responsabilidade emocional. A OpenAI espera que as novas medidas ajudem a evitar que a IA substitua o apoio humano em momentos de fragilidade mental.